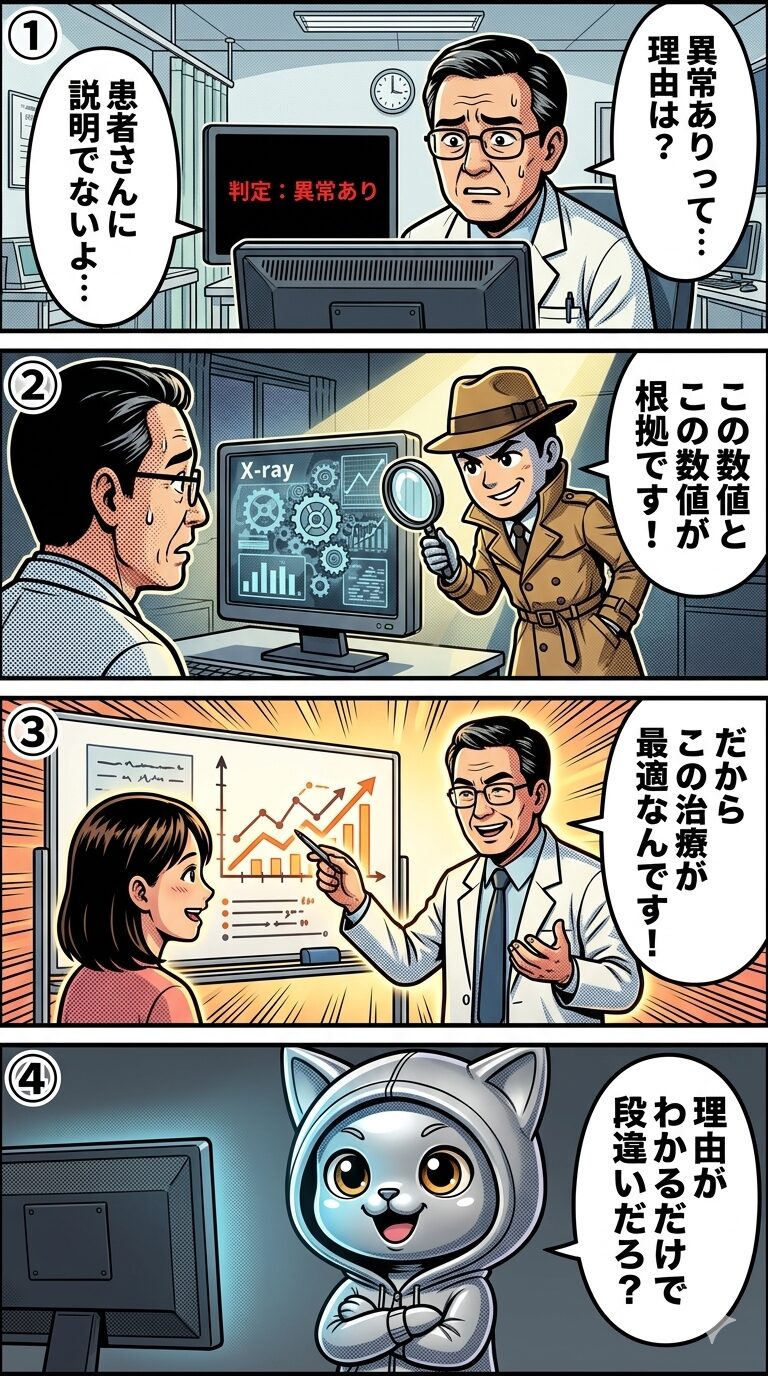

- AIが出した答えの理由を人間にわかるように説明してくれる技術のこと!

- 医療や金融など判断の根拠が求められる業務で、AIへの信頼性を高める役割がある

- 現場に導入するとAIの判断ミスの原因特定や改善がスムーズになり、安心してAIを活用できるようになる

医療現場でAIが異常ありと判定したものの、その理由が一切表示されない――これは実際にAI導入が進む医療機関で頻繁に起きている課題です。診断の根拠がわからなければ、医師は患者に対して治療方針を説明できません。仮にAIの判定が正しかったとしても、なぜその結論に至ったのかを示せない限り、医療行為としての説明責任を果たせないのが現実でしょう。

ここでXAI(説明可能なAI)の技術が力を発揮します。XAIは、AIがどのデータ項目をどの程度重視して判断したかを可視化する仕組みです。たとえば血液検査の数値や画像所見のどの部分が判定に影響したかを、医師が確認できる状態にしてくれます。これにより、AIの出力を医師自身が検証し、必要に応じて修正を加えることも可能になるわけです。

経営的な観点でも、XAIの導入は大きな意味を持ちます。EUの一般データ保護規則(GDPR)では、個人データに基づく自動処理の結果について説明を受ける権利が認められており、日本でも内閣府がAIの説明可能性を重要施策として掲げています。判断根拠を提示できないAIシステムは、法的リスクや信頼失墜のリスクを抱えることになるでしょう。逆に言えば、XAIを組み込むことで顧客や患者からの信頼を獲得し、AI活用の範囲を広げられる点が最大のメリットといえます。

【深掘り】これだけ知ってればOK!

従来のAI、とくにディープラーニングと呼ばれる技術は、非常に高い精度で予測や判断を行える反面、その判断の過程が複雑すぎて人間には理解しにくいという弱点がありました。これがいわゆるブラックボックス問題です。 たとえるなら、レストランで料理が出てきたけれど、シェフがどんな材料をどう調理したのか一切教えてくれない状態に近いでしょう。味は美味しいかもしれませんが、アレルギーのある人は安心して食べられません。

XAIは、このブラックボックスに窓をつけて中身を見えるようにする技術の総称です。具体的には、AIが判断に使ったデータのどの部分を重視したのか、どんなルールで結論に至ったのかを可視化してくれます。 2017年にアメリカの国防高等研究計画局(DARPA)がXAIの研究プロジェクトを発表したことをきっかけに、世界的に注目が高まりました。日本でも2018年に内閣府が発表した人工知能技術戦略の中で、説明できるAI技術の開発が施策として明記されています。

会話での使われ方

うちのAI審査システム、そろそろXAIの仕組みを入れないと、お客様から判断理由を聞かれたときに説明できないよ。

金融機関のシステム部門のリーダーが、チームメンバーに向けて発言した場面です。融資の可否をAIで判断しているものの、顧客への説明責任を果たせていない課題感を共有しています。

今回のAI導入提案には、XAIによる判断根拠の可視化も含めてください。経営層への説明材料として必須です。

クライアント企業の担当者が、AI開発ベンダーとの打ち合わせで要件を伝えている場面です。導入後に社内で承認を得るために、AIの判断プロセスを明示できる機能を求めています。

XAIって知ってる?AIの答えがブラックボックスにならないようにする技術だよ。SHAPやLIMEっていう手法が代表的だから、まずはそこから調べてみて。

開発チームの先輩エンジニアが、AI案件に初めてアサインされた後輩に向けて説明している場面です。具体的な技術名を挙げて学習の方向性を示しています。

【まとめ】3つのポイント

- AIの判断に理由書をつける技術:XAIは、AIの答えに対して根拠や理由を添える仕組みであり、料理のレシピを公開するようなもの

- 信頼と説明責任の向上:医療・金融・法律など、判断の透明性が求められる現場でAI活用のハードルを下げてくれる

- 導入しないリスクと導入後の安心感:XAIなしではAIの誤判断の原因究明が困難になるが、導入すれば改善サイクルが回り、組織全体のAI活用が加速する

よくある質問

-

QXAIを導入すると、AIの予測精度は下がりますか?

-

A

一般的に、モデルの複雑さと説明のしやすさにはトレードオフの関係があります。ただし、XAIは既存のAIモデルに後から説明機能を追加する手法(SHAPやLIMEなど)も多く、必ずしも予測精度を犠牲にするわけではありません。用途に合わせて手法を選ぶことが大切です。

-

QXAIはどんな業界で使われていますか?

-

A

特に活用が進んでいるのは医療、金融、製造の3分野です。医療ではAI診断の根拠を医師や患者に示すため、金融では融資審査や不正検知の判断理由を説明するため、製造では品質検査の判定根拠を可視化するために導入されています。

-

QXAIで使われるSHAPやLIMEとは何ですか?

-

A

どちらもAIの予測に対してどのデータ項目がどれだけ影響したかを数値で示す手法です。LIMEは個別の予測結果を局所的に分析し、SHAPはゲーム理論のシャープレイ値を応用して各データ項目の貢献度をより正確に算出します。どちらもPythonのライブラリとして公開されており、実務で広く利用されています。

-

QXAI(説明可能なAI)と責任あるAI(Responsible AI)との違いは何ですか?

-

A

XAIはAIが結果を出した後に、その判断の根拠を説明することに焦点を当てた技術です。一方、責任あるAIはAIの設計・開発段階から倫理や公平性を組み込むアプローチ全体を指します。XAIは責任あるAIを実現するための重要な要素の一つという位置づけになります。

【出典】参考URL

https://www.ibm.com/jp-ja/think/topics/explainable-ai :XAIの定義、手法(LIME・DeepLIFT)、予測精度・追跡可能性の解説の根拠

https://www.skillupai.com/blog/tech/about-xai/ :XAIの歴史的背景(DARPAプロジェクト、内閣府の戦略)、ブラックボックス問題、活用事例の根拠

https://www.alteryx.com/ja/resources/whitepaper/essential-guide-to-explainable-ai :XAIと解釈可能なAI(IA)の違い、金融・保険・医療での使用事例の根拠

https://ja.wikipedia.org/wiki/%E8%AA%AC%E6%98%8E%E5%8F%AF%E8%83%BD%E3%81%AAAI :XAIの定義・類型用語、DARPAの研究経緯、局所説明と大局説明の分類の根拠

https://freelance.techcareer.jp/articles/wp/detail/21956/ :XAIのメリット・デメリット、医療・金融・製造での活用例の根拠

コメント